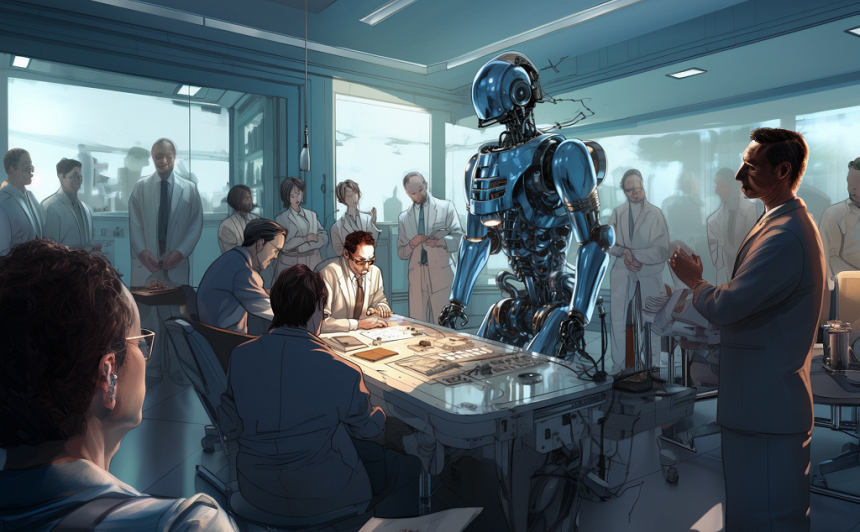

Korektuma dēļ jautājums ar ChatGPT starpniecību vispirms tika uzdots pašam mākslīgajam intelektam (MI).

Tātad – kāda ir mākslīgā intelekta bīstamība?

Atbilde: MI var radīt dažādas bīstamības situācijas.

- Ja MI tiek izmantots nepareizi vai ļaunprātīgi, tas var radīt sekas, piemēram, cilvēku tiesību un privātuma pārkāpumus, kā arī sabiedrības uzticības zaudēšanu.

- MI sistēmas var iekļaut diskriminējošus algoritmus, kas var pastiprināt nevienlīdzību un neobjektīvumu, ja tos izmanto izvērtēšanas vai atlases procesos.

- MI var tikt ļaunprātīgi izmantots, lai veiktu kiberuzbrukumus, izplatītu viltotus ziņojumus vai pārņemtu datorus un tīkla iekārtas.

- Militārās MI sistēmas var darboties bez cilvēka iejaukšanās, tas rada risku izraisīt nesaprātīgu vardarbību un konfliktus.

- Automatizācija un MI var aizstāt cilvēka darbaspēku dažās nozarēs, kas var radīt ekonomiskas un sociālas problēmas.

MI tika uzdots arī mazliet citādi formulēts jautājums: kādi ir mākslīgā intelekta izmantošanas riski?

Atbilde bija līdzīga, taču ar dažām atšķirīgām niansēm: MI rada dažādus riskus un izaicinājumus.

- Darbavietu zaudēšana: MI var aizstāt cilvēku darbu dažādās nozarēs, kas var izraisīt bezdarbu un prasmju aktualitātes zaudējumu.

- Datu privātums: izmantojot MI, var būt risks attiecībā uz datu privātumu, jo tiek apkopots un analizēts liels daudzums personisku datu.

- Algoritmu diskrimināciju: MI sistēmas var radīt vai pastiprināt diskrimināciju, kas var ietekmēt cilvēku dzīvi negatīvā veidā.

- Drošība un ļaunprātīga izmantošana: MI sistēmas var būt jutīgas pret ļaunprātīgu izmantošanu, piemēram, veidojot viltotus video vai ģenerējot dezinformāciju.

- Atkarība no tehnoloģijām: pārmērīga atkarība no MI var samazināt cilvēku spēju pašiem risināt problēmas un pieņemt lēmumus.

- MI sistēmas var nekorekti klasificēt cilvēkus vai situācijas, kas var izraisīt netaisnību un diskrimināciju.

MI atzīst, ka šie ir tikai daži no riskiem, kas saistīti ar tā izmantošanu. Svarīgi ir pievērst uzmanību ētikas, regulējuma un drošības jautājumiem, lai mazinātu šos riskus un nodrošinātu MI pozitīvu ietekmi uz sabiedrību. Tātad pats MI uzskata, ka nepieciešams regulējums.